北京时间2026年4月10日发布 | 技术科普 + 原理讲解 + 代码示例 + 面试要点

近年来,AI 大模型的热潮让“对话式智能”走进了每个人的日常,但用户真正的诉求,远不止于得到一个会聊天的机器人,而是希望 AI 能像真人一样实实在在地操作电脑、完成跨应用的复杂任务。这正是 Windows 桌面 AI 助手的核心价值所在——将 AI 从“只会说”的顾问,升级为“能动手”的数字员工。

在日常开发与使用中,很多人其实都会遇到这样的困惑:明明 AI 能写出精妙的代码,却无法帮你点开文件管理器;明明模型能理解“帮我整理今天的所有文档”,却不知道你的文件夹在哪里。懂原理但不落地,会提问但不会操作,这是当前 AI 应用最大的断裂点。本文将从 Windows 桌面 AI 助手的基本概念入手,带你理清“智能体 OS”的技术逻辑,看懂代码示例,掌握高频面试考点,真正打通从概念到实践的最后一公里。

一、痛点切入:为什么我们需要 Windows 桌面 AI 助手?

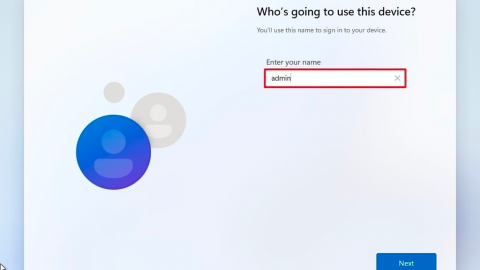

在桌面自动化领域,传统实现方式通常依赖脚本或录制宏。例如,使用 Python 的 pyautogui 库编写一段自动化脚本:

import pyautogui import time 传统方式:基于坐标的桌面自动化 def open_notepad_and_write(): 打开运行窗口 pyautogui.hotkey('win', 'r') time.sleep(0.5) pyautogui.write('notepad') pyautogui.press('enter') time.sleep(1) 在固定坐标位置输入文本(假设记事本窗口在屏幕中央) pyautogui.click(960, 540) pyautogui.write('Hello, World!') pyautogui.hotkey('ctrl', 's')

这段代码看似简单,却隐藏着三大致命缺陷:

耦合度极高:坐标位置(960,540)硬编码,一旦显示器分辨率改变或窗口位置移动,脚本立刻失效-34。

扩展性极差:添加新功能需要重新定位每个 UI 元素的坐标。

维护成本高:Windows 更新后 UI 样式变化,所有坐标都可能需要重新校准。

正因如此,行业开始呼唤一种更智能的解决方案——让 AI 自身具备理解桌面环境、识别 UI 控件、执行操作的能力,而非依靠人类预先编写死板的坐标脚本。这就是 Windows 桌面 AI 助手诞生的根本动因。

二、核心概念:Windows 桌面 AI 助手(Windows Desktop AI Assistant)

标准定义:Windows 桌面 AI 助手(Windows Desktop AI Assistant,简称 WDAA)是指深度集成于 Windows 操作系统中的 AI 智能体,具备感知桌面环境、理解用户意图、自主执行跨应用任务的能力,旨在将 AI 从被动对话工具转变为主动的桌面数字助理-20。

关键词拆解:

桌面:指 Windows 图形用户界面环境,包括窗口、控件、文件等元素。

AI 助手:区别于传统脚本,它具备多模态感知(视觉+文本+语音)和自主决策能力。

深度集成:它不是跑在系统之上的独立应用,而是嵌入操作系统核心层的基础设施。

生活化类比:传统 AI 就像一个电话顾问,你说需求,它给建议,但最终还得你自己动手去操作-1。而 Windows 桌面 AI 助手则像一名全职数字员工——你说“帮我把今天收到的合同整理成一份报告”,它就会自动打开文件管理器、扫描邮件附件、启动 Word 并生成文档-39。

核心价值:将 AI 从“只说不做”的瓶颈中解放出来,实现从“理解意图”到“完成任务”的闭环。

三、关联概念:智能体操作系统(Agentic OS)

标准定义:智能体操作系统(Agentic Operating System,Agentic OS)是指操作系统本身具备支持并协调多个 AI 智能体来自主思考、规划并执行任务的能力。它不再是被动等待用户指令,而是能主动理解意图并自主完成一系列复杂操作-24。

Windows 桌面 AI 助手 vs 智能体操作系统:

| 维度 | Windows 桌面 AI 助手 | 智能体操作系统(Agentic OS) |

|---|---|---|

| 角色定位 | 具体实现层,是 Agentic OS 中的核心组件 | 顶层设计理念,是操作系统的演进方向 |

| 粒度 | 单个 AI 助手实例 | 整个 OS 层面对多智能体的支持框架 |

| 关系 | 是 Agentic OS 的“执行者” | 是 Windows 桌面 AI 助手的“运行环境” |

一句话概括:Agentic OS 是房子,Windows 桌面 AI 助手是房子里那个能帮你做家务的管家-12。

运行机制示例:当用户说出“Hey Copilot,帮我把这个投资组合网页转成一份个人简介”时,Copilot Voice 负责理解语音指令,Copilot Vision 扫描屏幕内容,Copilot Actions 自动打开 Word 并撰写文本。整个过程 AI 智能体在独立桌面环境中运行,用户可随时监控进度并接管控制-24。

四、技术架构分层解析

Windows 桌面 AI 助手的底层技术架构可划分为四层:

第一层:环境感知层(Perception Layer)

通过系统 API(如 Win32 API、UI Automation)持续监控系统状态,包括窗口句柄、控件树、进程列表等动态数据-31。微软 UFO² 框架采用 多后端融合策略,将 API 检测(UIA/Win32)与视觉定位(OmniParser)的结果合并,生成全面的控件列表-30。

第二层:决策规划层(Planning Layer)

由 HostAgent 作为集中控制平面,负责将用户自然语言目标分解为结构化子任务,并实例化和调度 AppAgent 模块执行-38。这一层引入了 投机性多行动规划 技术,可并行规划多个操作路径,大幅减少 LLM 调用开销-38。

第三层:执行控制层(Execution Layer)

通过 Puppeteer 执行协调器,在 GUI 自动化和原生 API 调用之间动态选择最优方案。对于复杂操作(如 Excel 中的反复格式化),优先调用 API;对于通用场景,则回退至 GUI 级控制-38。

第四层:安全隔离层(Security & Isolation Layer)

智能体工作区(Agent Workspace)提供了一个受控的策略可审计执行环境。每个 AI 智能体在其独立的 Windows 标准账户下运行,不具备管理员权限,默认仅能访问文档、下载等标准文件夹-39-41。

五、技术实现:底层原理与代码示例

5.1 底层原理支撑

Windows 桌面 AI 助手的能力依赖三大底层技术:

Win32 API + UI Automation:通过

EnumWindows、GetWindowTextW、SendMessageW等 API 与窗口系统交互-34。MCP(Model Context Protocol):微软引入的标准化框架,允许 AI 智能体发现系统工具、与应用交互,甚至与其他智能体协作-12-21。

NPU 本地推理:以微软“Mu”小型语言模型为例,它运行在 NPU 上,响应时间控制在 500 毫秒以内,在保护隐私的同时保证实时性-40。

5.2 代码示例:基于 Win32 API 的控件识别

以下是一个简化的 Python 示例,展示如何通过 Win32 API 获取窗口控件信息:

import win32gui import win32con def enumerate_windows_and_controls(): """枚举所有顶层窗口并输出控件信息""" def enum_callback(hwnd, extra): if win32gui.IsWindowVisible(hwnd): window_text = win32gui.GetWindowText(hwnd) class_name = win32gui.GetClassName(hwnd) print(f"窗口: {window_text} | 类名: {class_name} | 句柄: {hwnd}") return True 枚举所有顶层窗口 win32gui.EnumWindows(enum_callback, None) 示例:查找记事本窗口并激活 def find_and_activate_notepad(): hwnd = win32gui.FindWindow("Notepad", None) if hwnd: win32gui.SetForegroundWindow(hwnd) win32gui.ShowWindow(hwnd, win32con.SW_RESTORE) print(f"已激活记事本窗口 (句柄: {hwnd})") else: print("未找到记事本窗口") if __name__ == "__main__": enumerate_windows_and_controls() find_and_activate_notepad()

关键点:这段代码展示了 Windows 桌面 AI 助手底层依赖的基础能力——通过系统 API 精准识别窗口和控件,避免了图像识别方式因分辨率变化导致的定位失效问题-34。

5.3 与 LLM 的集成链路

伪代码:Windows 桌面 AI 助手与 LLM 的协作流程 class WindowsAIAssistant: def execute_natural_language_command(self, user_input): 1. LLM 解析用户意图 intent = self.llm.parse(user_input) 返回: {"action": "summarize", "target": "document.docx"} 2. 系统级工具调用(通过 MCP 协议) if intent["action"] == "summarize": file_path = self.mcp.find_file(intent["target"]) file_content = self.mcp.read_file(file_path) 3. LLM 生成摘要 summary = self.llm.summarize(file_content) 4. 执行 UI 操作 self.ui_controller.open_word() self.ui_controller.write_text(summary) self.ui_controller.save_file("summary_" + intent["target"]) return "任务已完成" 整个链路体现了:感知(文件定位)→ 决策(LLM 规划)→ 执行(UI 操作)

六、最新发展动态(2026 年 4 月)

6.1 微软 Copilot 战略调整

2026 年 3 月,微软宣布调整 Windows 11 的 AI 战略,将 Copilot 从“无处不在”的嵌入模式转向“按需调用”的简洁路线,旨在减少对用户的干扰,让 AI 作为后台能力在真正有用时才被唤醒-14。同时,微软继续在任务栏和文件管理器中集成“Ask Copilot”体验,支持通过“@”命令语法启动专用 AI 智能体执行长耗时任务-5。

6.2 Claude Cowork 正式支持 Windows

2026 年 4 月 2 日,Anthropic 宣布 Claude Cowork 与 Claude Code Desktop 的“电脑操作”功能正式支持 Windows 平台,允许 Claude 直接与本地文件和应用交互,用于代码库分析、自动化脚本与调试-2。

6.3 云知声 U2Claw 桌面级 AI Agent 上线

2026 年 4 月 8 日,云知声发布 U2Claw 桌面级 AI Agent,全面适配 Windows 10/11,无需编程即可安装使用。它通过上下文感知压缩和冗余指令过滤,Token 消耗节约 50% 以上,并内置 77+ 个专业 Skill-1。

七、高频面试题与参考答案

面试题 1:请简述 Windows 桌面 AI 助手的技术架构

参考答案(建议记忆层次):

Windows 桌面 AI 助手的技术架构通常分为四层:

感知层:通过 Win32 API 和 UI Automation 获取系统状态,包括窗口句柄、控件树、进程列表等。

规划层:由 HostAgent 将自然语言目标分解为子任务,实例化并调度 AppAgent 模块。

执行层:通过 Puppeteer 协调器在 GUI 自动化和原生 API 之间动态选择最优方案。

安全层:利用智能体工作区(Agent Workspace)实现进程隔离,每个 AI 智能体运行在独立账户下,遵循最小权限原则。

踩分点:分层清晰 + 每层核心组件 + 安全隔离机制。

面试题 2:MCP(Model Context Protocol)在 Windows 桌面 AI 助手中起什么作用?

参考答案:

MCP(Model Context Protocol)是微软引入的标准化框架,核心作用包括:

标准化工具发现:让 AI 智能体能发现系统级别的工具和应用能力-12。

跨应用协作:支持不同 AI 智能体之间以及智能体与原生应用之间的互操作-21。

统一交互接口:App Agent 通过 MCP 可将应用功能暴露给 AI 智能体调用。

安全可控:MCP 配合智能体工作区,实现了权限管理和操作审计。

踩分点:定义 + 三大功能(发现/协作/统一接口)+ 安全意义。

面试题 3:Windows 桌面 AI 助手如何保证操作安全性?

参考答案(四点核心原则):

智能体工作区隔离:AI 智能体运行在独立的轻量级 Windows 会话中,与用户主桌面完全隔离-41。

最小权限模型:每个 AI 智能体使用独立的 Windows 标准账户运行,不具备管理员权限-39。

数字签名验证:所有 AI 智能体必须经过数字签名,微软可验证其来源并撤销恶意智能体-39。

用户授权机制:执行敏感操作(如访问文件、修改系统设置)前必须获得用户明确授权。

踩分点:隔离 + 权限 + 签名 + 授权,四点缺一不可。

面试题 4:传统桌面自动化和 AI 驱动的桌面智能体有什么本质区别?

参考答案:

| 对比维度 | 传统自动化(如 pyautogui 脚本) | AI 驱动的桌面智能体 |

|---|---|---|

| 执行方式 | 基于固定坐标和预定义流程 | 基于自然语言理解和动态决策 |

| 鲁棒性 | 分辨率/UI 变化即失效-34 | 通过多模态感知自适应界面变化 |

| 泛化能力 | 每个应用需单独编写脚本 | 一次训练可泛化到多种应用 |

| 交互方式 | 只能执行预编程操作 | 支持自然语言对话式交互 |

踩分点:三个核心差异(鲁棒性/泛化性/交互方式)+ 示例说明。

八、结尾总结

本文围绕 Windows 桌面 AI 助手 这一核心主题,从四个维度进行了系统梳理:

概念理解:Windows 桌面 AI 助手 = 深度集成于操作系统的 AI 智能体,能将自然语言指令转化为跨应用的桌面操作。

技术架构:感知层(Win32 API/UI Automation)→ 规划层(HostAgent)→ 执行层(Puppeteer)→ 安全层(Agent Workspace)的四层结构。

代码实战:Win32 API 获取窗口控件的示例 + LLM 集成链路的伪代码,帮助理解底层实现。

面试考点:技术架构、MCP 协议、安全机制、传统 vs AI 自动化四大高频问题。

重点易错点提醒:

❌ 不要将 Windows 桌面 AI 助手等同于普通的聊天机器人——关键在于“操作能力”而非“对话能力”。

❌ 不要混淆 Agentic OS(操作系统层面的框架设计)与单个 AI 助手实例(具体实现)。

✅ 牢记“感知→规划→执行→隔离”的四层链路,面试中能清晰讲出每一层的职责即可得分。

进阶方向预告:下一篇文章将深入解析微软 UFO² 框架的 HostAgent 与 AppAgent 协作机制,并探讨如何在 Windows 上使用 MCP 协议自建桌面 AI 助手工具链,敬请期待。

扩展思考:截至 2026 年 4 月,Windows 在全球桌面操作系统的份额约为 72%-2。当 Windows 桌面 AI 助手真正普及后,你认为它最有可能最先取代哪一类日常办公操作?欢迎在评论区留下你的看法。